第67期

出刊日:2024-01-15

返回上一層ChatGPT熱潮, 為醫療現場帶來哪些衝擊與影響?

ChatGPT代表的「生成式AI」引起世人對人工智慧(artificial intelligence, AI)的新一波關注。在醫療現場,生成式AI將可能減輕醫療人員的工作負擔,也能讓病人在看診前先對疾病有基礎了解。除此之外,還有哪些應用?又該注意什麼?

諮詢∕李建璋(臺大醫院智慧醫療中心副主任、臺大醫學院急診醫學科臨床教授、臺大醫院急診醫學部主治醫師)

撰稿∕陳育晟

人工智慧在醫學上的運用已經發展多年,藉由「餵」給AI大量正確的醫學資料後,讓AI懂得從大量數據中彙整、歸納後得到結論。這種「推論式AI」可以看得懂心電圖、腦波、X光、電腦斷層、磁振造影,甚至是動態超音波的資料,已經運用在許多醫療現場,成為醫師的得力助手,輔助醫師快速做出正確的診斷。而現在又有ChatGPT代表的「生成式AI」,掀起新一波衝擊。

ChatGPT逐漸在醫療現場產生影響

「生成式AI」不只能推理、彙整、歸納,還能在接受指令後生成文本,甚至還能生成圖片、影像。不難想像,人類能做的,未來都有可能請ChatGPT代勞。

事實上,ChatGPT當中,GPT的意思是generative pre-trained transformer,是一種大語言通用模型。ChatGPT甫推出就對各行各業造成影響,勢不可擋,醫療領域也不例外。已有患者在看診前,會先詢問ChatGPT這些症狀是什麼疾病,也有患者會拿詢問ChatGPT的結果,做為和醫師討論病情的依據。

2023年9月媒體報導,美國一位4歲男孩在疫情期間出現不明疼痛,花了3年看了17位醫師,都無法得到明確診斷。媽媽將男孩的所有症狀、檢查的數據與影像輸入ChatGPT,得到了「脊髓牽扯症候群(tethered cord syndrome)」的答案,再去與醫師確認,最後由神經外科醫師確定診斷為「隱形脊柱裂(spina bifida occulta)」,透過手術,男孩已獲得改善。

上述案例顯示,在罕見疾病的診斷上,ChatGPT或大語言模型未來能發揮更多功能。因為臨床疾病約有十幾萬種,但每位醫師診斷過的疾病有限,尤其是罕見疾病更是難得一見。在醫師時間、記憶能力有限的前提下,ChatGPT可以提供更多線索,讓醫師面對罕見疾病時有診斷方向。

未來也會有醫學專門的大語言模型

ChatGPT還有哪些醫療上的應用與影響呢?例如,能減輕護理師的臨床工作。護理師的護理記錄、監測患者生命徵象等工作佔去工作大部份時間,但若有ChatGPT,可以利用語音輸入生成紀錄,還能發展「一鍵交班」,將十多位病人的資料整理成清單,不需要再額外花時間整理紀錄,護理師可以更專注在照顧病患;生命徵象監測部分也可以導入無線的穿戴式裝置,再利用AI監測,若有問題可自動示警亮燈,不需要每一床緊迫盯人,減輕護理師的工作負擔。

另外,目前病人服藥後若產生副作用或不良反應,倚賴病人告知醫師,醫師再警覺去通報,可能會漏失,並不完整;未來如果導入ChatGPT等大語言模型,結合自動化分析的藥物監測,可以及時發現細微但嚴重的藥物不良反應。

ChatGPT為一般人都可使用的通用大語言模式,未來也會有不同專門領域的「專用大語言模式」。如Google已經在發展的Med-PaLM,是醫學領域專用的語言模型,也就是把所有醫學資訊讀完後訓練出來的生成式AI,有望成為未來醫師重要的專業輔助工具。

ChatGPT的「幻覺」風險待解決 民眾只能參考勿盡信

ChatGPT看似可以解決很多問題,但在醫療場域中,也不是萬無一失。例如,ChatGPT有產生「幻覺」(hallucination)的問題,也就是它給的答案並不正確,在真實世界並不存在。

但沒有受過專業醫療訓練的民眾,往往難以判斷哪些內容是「幻覺」。科學上一直希望可以解決這問題,需要透過提供更多正確及專業的資料去訓練ChatGPT,並對模型進行微調(fine tuning),才能減少幻覺產生。

因此,一般民眾最好還是把ChatGPT當成參考、輔助角色,其建議不該照單全收,更不應該因此不去就醫。患者有健康或醫療上的疑問,可以先透過ChatGPT取得一些基本了解及建議,最終還是必須就醫由醫師確認。

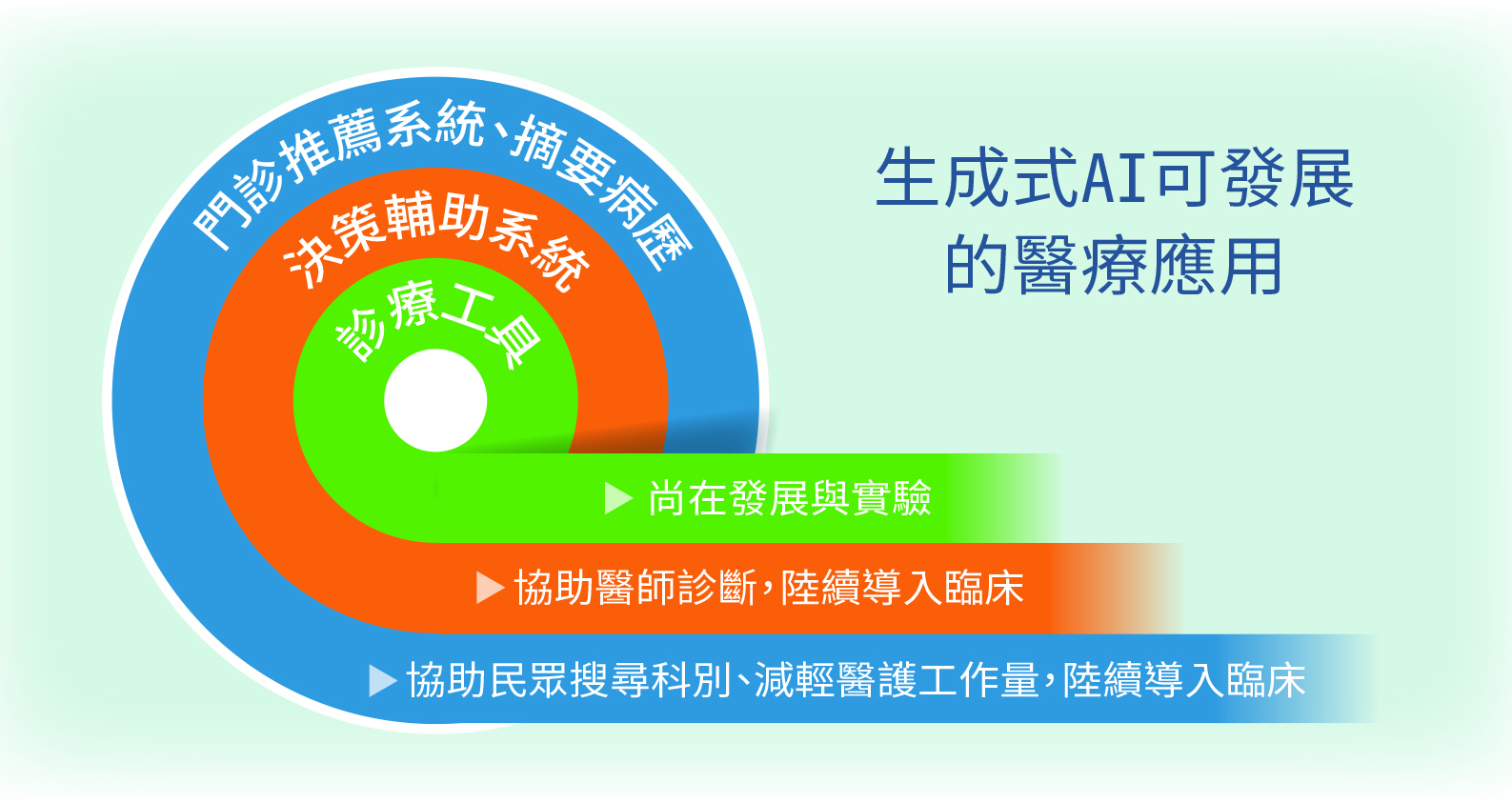

ChatGPT的三種醫療應用

ChatGPT實際可發展的醫療應用,可以用三個同心圓來說明。最外圍的一圈,ChatGPT可把海量資料做摘要,提供建議,對病人病情生命不會有直接決定性影響。例如,一般人到醫院就診前,可能不知該看哪一科,醫院可在門診推薦系統導入ChatGPT,就能幫助患者找到適合的科別。另外,ChatGPT也能幫助整合不同醫院的病歷摘要,供醫師迅速了解病情。在這種情況下,ChatGPT只是把現有的資料整理後摘錄重點,並不涉及憑空生成文本,不會有「幻覺」產生。

第二圈,是提供一些病人的症狀請教ChatGPT診斷或治療的建議,再透過醫學標準診斷程序做最後確認,是一種「決策輔助系統」。

最核心的圓圈,則是將ChatGPT直接作為診療工具,目前已經在發展的是心理治療領域。有些身心疾病患者,需要心理諮商或長時間陪伴,而博覽心理治療專業資料、擁有一兆以上參數的ChatGPT可變成聊天機器人,很有耐心、不會發脾氣,而且成本也比和諮商師洽談低,但前提是要事先提供該模型正確的資料。

上述的同心圓,目前第一圈、第二圈已經在許多醫療院所陸續導入,但最核心的這一圈仍在發展與實驗階段,若要廣泛運用還需要經過專業人士把關、微調與認證。

AI醫療應用遍地開花 病人生命徵象異常可提前示警

ChatGPT等大型語言模式仍在急速發展階段,但「推論式AI」的醫療器材或軟體已在醫療現場實際使用,據媒體報導,國內至今已有將近百件以AI技術為主的醫療器材取得國內許可證,百餘件正排隊等待審查;2023年10月,健保也已經給付首款可以監測病人生理參數的AI醫材,可以監測麻醉高風險患者的血壓變化,並在病人發生低血壓的15分鐘前預警。

為了因應這股人工智慧浪潮,臺大醫院在2020年就成立智慧醫療中心,目前累積研發近30種AI模型,其中實際落地約6種。未來可望在各科別持續發展AI模型,而且資料量能期待越來越多,不只是院內資料,還包括跨院、跨國資料。

例如臺大醫院也開發了一款可以在加護病房識別高危險患者的AI系統,病人若有生命徵象異常,可以提早6到12小時示警,此系統已經進入跨院驗證階段,也已申請相關專利。

加護病房最擔心病人發生猝死、呼吸衰竭或休克,通常發生上述狀況前的1?2小時,醫護人員才會察覺病人生命徵象異常,如果導入AI偵測血壓、呼吸、心跳等相關數據,則可以提早發現,讓醫護人員及早因應。

AI能及早發現異常的原因是,病人的心跳、呼吸、收縮壓、舒張壓、平均壓、心電圖等數據,彼此牽一髮而動全身,但人類往往只能單點思考,但AI透過電腦平行運算,能提早發現這些數據的趨勢已經走向異常,並提前示警。醫師得知警示後,能提早診斷治療,可以想像這樣的AI就像是導航系統。

生成病歷仍是不可跨越的法規紅線

不過,AI在醫療領域的應用,有一條不可觸碰的紅線,就是生成病歷。根據醫師法第12條規定,醫師應親自製作病歷;目前有若干醫療院所已導入AI語音工具製作病歷,是由醫師或護理師口述患者體溫、呼吸、心跳、食慾和精神等資料,透過AI把這些內容轉化為高品質文字,這樣並不算踩到法規紅線。反之,如果是把加護病房中的錄影影像,直接上傳至ChatGPT生成病歷或護理紀錄,則違反醫師法規定。

從推論式AI再到生成式AI,人工智慧未來一定會在醫療領域發揮更多功能,也會改變下一個世代醫師的訓練與養成。AI雖然可以協助分擔醫師、護理師的部分工作,但人類還是有是非、善惡、同理心、同情心,這些是人工智慧現階段尚未學習的,此外,大語言模型的價值觀容易由少數公司把持,導致價值觀窄化,如何監管是需要各國政府處理與思考的議題,讓AI能幫助世人解決各種難題,而不致反噬人類。

請別錯過本期其他精彩內容…

- 編輯筆記 / 「疫苗」治療癌症 前景可期

- 新聞NEWS一下 / 知名漫畫家大腸癌病逝定期篩檢、避開風險因子 遠離大腸癌

- 新聞NEWS一下 / 知名女星驟逝 生前飽受自體免疫疾病困擾

- 個人化癌症疫苗 開啟癌症治療新頁!

- 研發個人化癌症疫苗 台灣急起直追 奈米疫苗另闢蹊徑

- 肺癌在台灣首度登上發生率第一!篩檢與治療進展迅速 晚期也不用灰心

- 癌症精準醫療跨大步次世代基因定序(NGS)將納健保

- 基因性視網膜退化有失明危機 基因治療重見光明!

- 人生最後一程如何好好走?「斷食善終」與安寧緩和醫療有什麼不同?

- 健保擴大給付 缺血性腦中風,及時打通血管可免失能!

- 搔癢抓不停、出現黑褐色斑點… 銀髮族常見皮膚問題如何處置?

- 冬天呼吸道病菌齊發!如何治療及照顧?

- 頻尿、漏尿、夜尿… 是間質性膀胱炎嗎?

- 神經有嘻哈 楊智超醫師專欄 / 帶狀疱疹的治療與預防

- 消脂保肝專欄 粘曉菁醫師 / 肥胖加重睡眠呼吸中止症 積極減重可逆轉!

- 曾宇婷醫師專欄 / 睡眠與血糖控制息息相關!

- 透視青光眼 王清泓醫師專欄 / 眼科檢查為什麼需要散大瞳孔?